ईरान और इजरायल/अमेरिका के बीच चल रहे युद्ध के 26वें दिन, द क्विंट की फैक्ट चेकिंग टीम 'वेबकूफ' ने पाया कि करीब 50% दावों में ऐसे विज़ुअल थे जो आर्टिफिशियल इंटेलिजेंस (AI) से बनाए गए थे.

यह पहली बार नहीं है कि किसी युद्ध में AI का इस्तेमाल हो रहा है, लेकिन इस समय AI से बने वीडियो और तस्वीरें बनाना पहले से ज्यादा आसान और सस्ता हो गया है. इससे गलत जानकारी और भ्रामक दावों के जरिए एक तरह का नैरेटिव वॉर शुरू करना भी पहले की तुलना में अब काफी आसान हो गया है.

लेकिन, यह वह समय भी है जब फैक्ट-चेकर और पत्रकार AI का इस्तेमाल करके ऐसी गलत और भ्रामक जानकारी को पहचानने और उसे गलत साबित करने में भी सक्षम हो रहे हैं.

रूस का यूक्रेन पर हमला या गाज़ा पर इज़रायल के हमले जैसे पिछले युद्ध एक फैक्ट-चेकर के तौर पर कवर करने पर —हमने देखा कि इस बार गलत जानकारी फैलाने के लिए पुराने वीडियो नए बताकर शेयर करने का तरीका कम इस्तेमाल हो रहा है. इसके बजाय, अब सरकारी और गैर-सरकारी पक्ष पूरी तरह से AI से बनाए गए वीडियो शेयर कर रहे हैं, ताकि एक-दूसरे के देशों पर हमले का दावा किया जा सके.

AI से बनी तस्वीरों और वीडियो की क्वालिटी लगातार बेहतर होती जा रही है, और इसका असर आने वाले समय के युद्धों पर बहुत बड़ा हो सकता है. सरकारी पक्ष (state actors) इसका इस्तेमाल युद्ध को लंबा खींचने के लिए कर सकते हैं, वहीं कुछ अन्य पक्ष इसका इस्तेमाल लोगों की भावनाओं को भड़काने और शेयर बाजार को प्रभावित करने के लिए कर सकते हैं.

पश्चिम एशिया (West Asia) संकट के बीच AI से फैली गलत जानकारी

फैक्ट-चेकिंग और डेटा एनालिसिस कंपनी न्यूज़गार्ड ने युद्ध के पहले 25 दिनों में 50 गलत दावों को ट्रैक किया. इन दावों को मिलाकर करोड़ों व्यूज़ मिले, और औसतन हर दिन करीब 2 नए झूठे नैरेटिव सामने आए.

इनमें से ज़्यादातर दावे ईरान के पक्ष में माहौल बनाने वाले थे, जिनमें AI से बनी तस्वीरों का इस्तेमाल बढ़ता जा रहा है. कई बार ये दावे भरोसेमंद रिपोर्टिंग को भी “फर्जी” बताने की कोशिश करते हैं. ऐसे दावों की संख्या बहुत कम थी जो सीधे तौर पर ईरानी सरकारी मीडिया से आए थे.

वायरल दावों में एक तस्वीर भी शामिल थी, जिसमें कहा गया कि ईरान के सर्वोच्च नेता अयातुल्ला अली खामेनेई को तेहरान पर कथित अमेरिका-इज़रायल हमलों के बाद मलबे से निकाला जा रहा है. यह दावा उस समय सामने आया जब अमेरिका के राष्ट्रपति डोनाल्ड ट्रंप और इज़रायल के प्रधानमंत्री बेंजामिन नेतन्याहू ने उनके मारे जाने की बात कही थी.

पहली नजर में यह तस्वीर असली लग सकती है, लेकिन इसमें कई गड़बड़ियां हैं. टीम WebQoof के विश्लेषण में पाया गया कि यह सीन बनावटी लगता है, जिसमें कुर्सी की जगह और पगड़ी जैसी चीजें आर्टिफिशियल तरीके से रखी हुई लगती हैं.

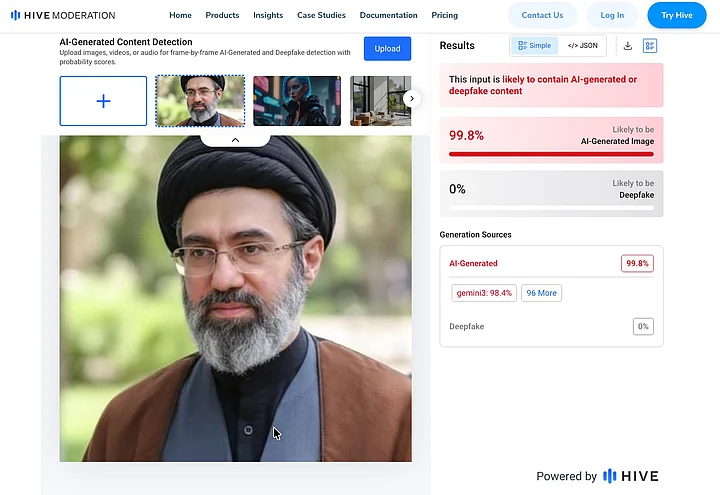

AI डिटेक्शन टूल Hive Moderation ने पाया कि यह तस्वीर 90 प्रतिशत तक AI से बनाई गई है.

सोशल मीडिया पर यह अफवाह भी तेजी से फैली कि संघर्ष के बीच ईरान ने नेतन्याहू की हत्या कर दी है. यूजर्स का दावा था कि उन्होंने युद्ध के पहले 12 दिनों में न तो कोई सार्वजनिक कार्यक्रम किया और न ही मीडिया से बात की.

इसके बाद कई यूजर्स ने एक तस्वीर शेयर की, जिसमें दिखाया गया कि नेतन्याहू को मलबे से कई लोग निकाल रहे हैं, और दावा किया गया कि उनकी मौत हो गई है. हालांकि, टीम WebQoof ने पाया कि यह तस्वीर AI से बनाई गई थी.

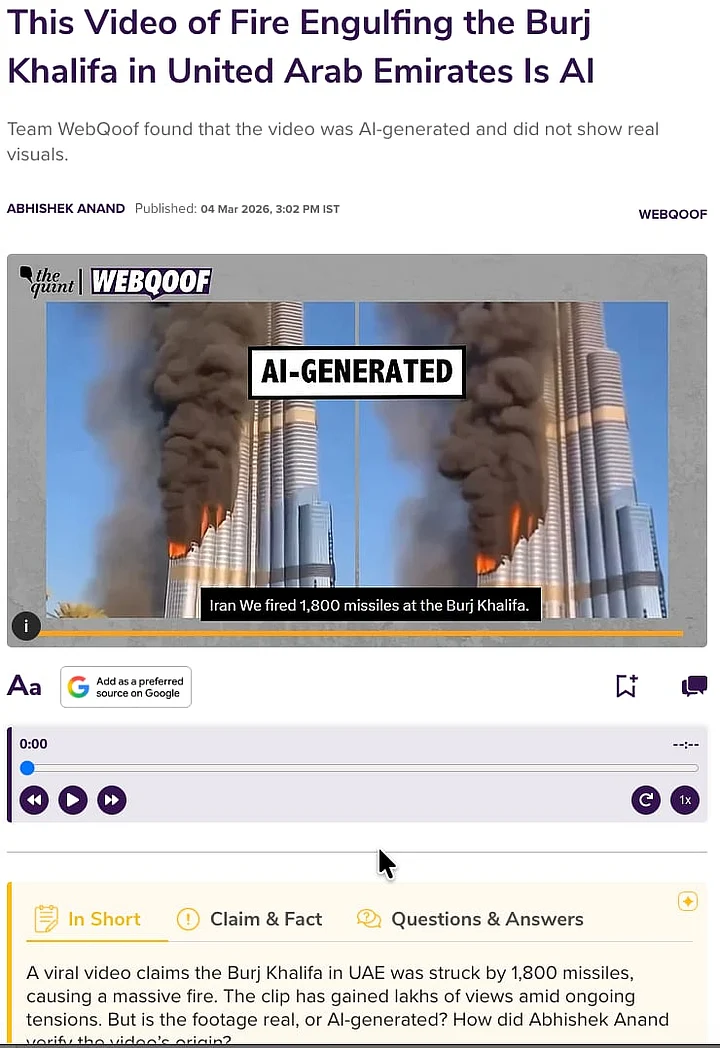

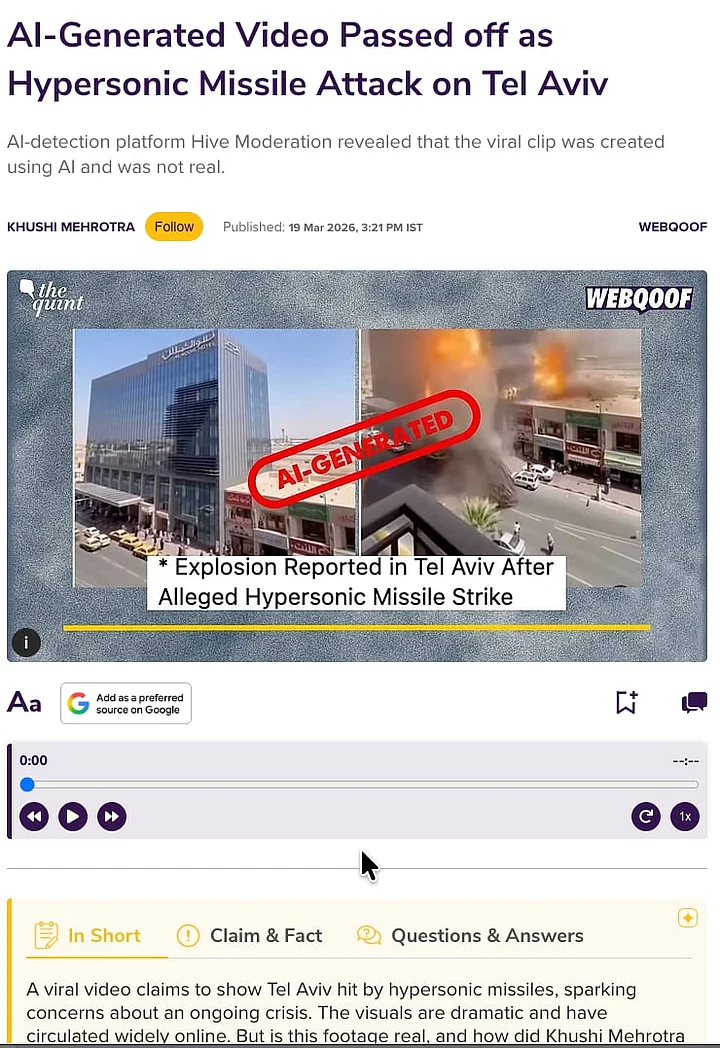

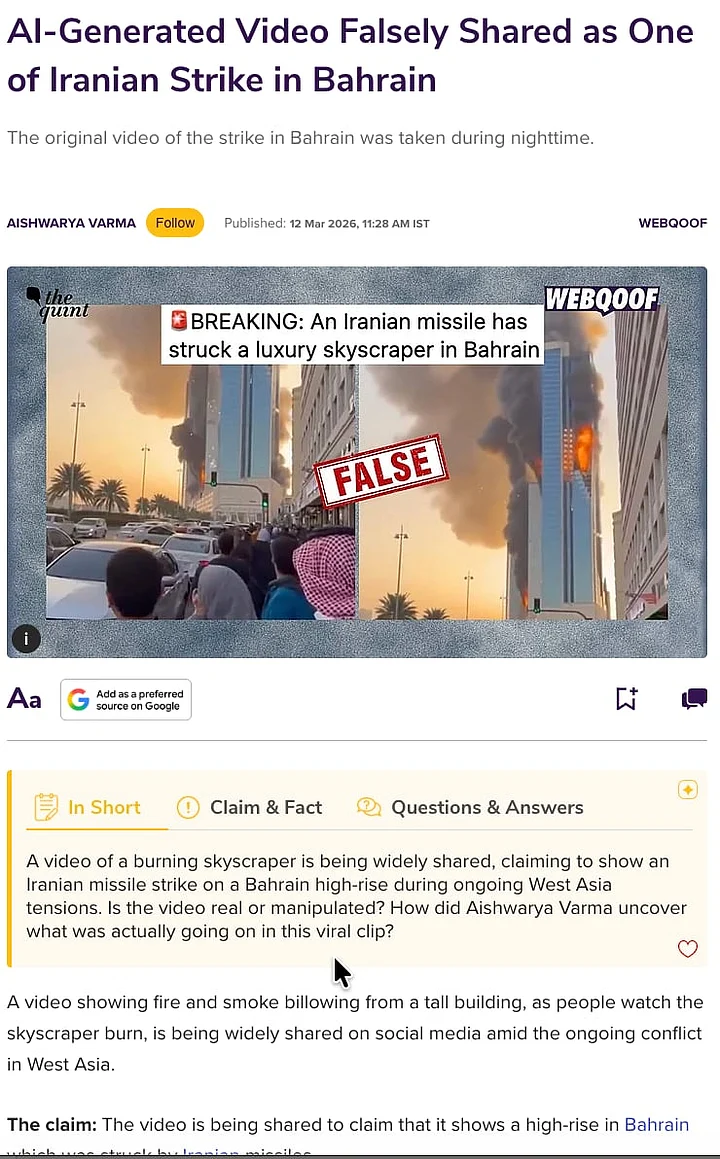

AI से बने कंटेंट में एक बड़ा हिस्सा इमारतों और खुले इलाकों पर बमबारी या हमले के वीडियो का था.

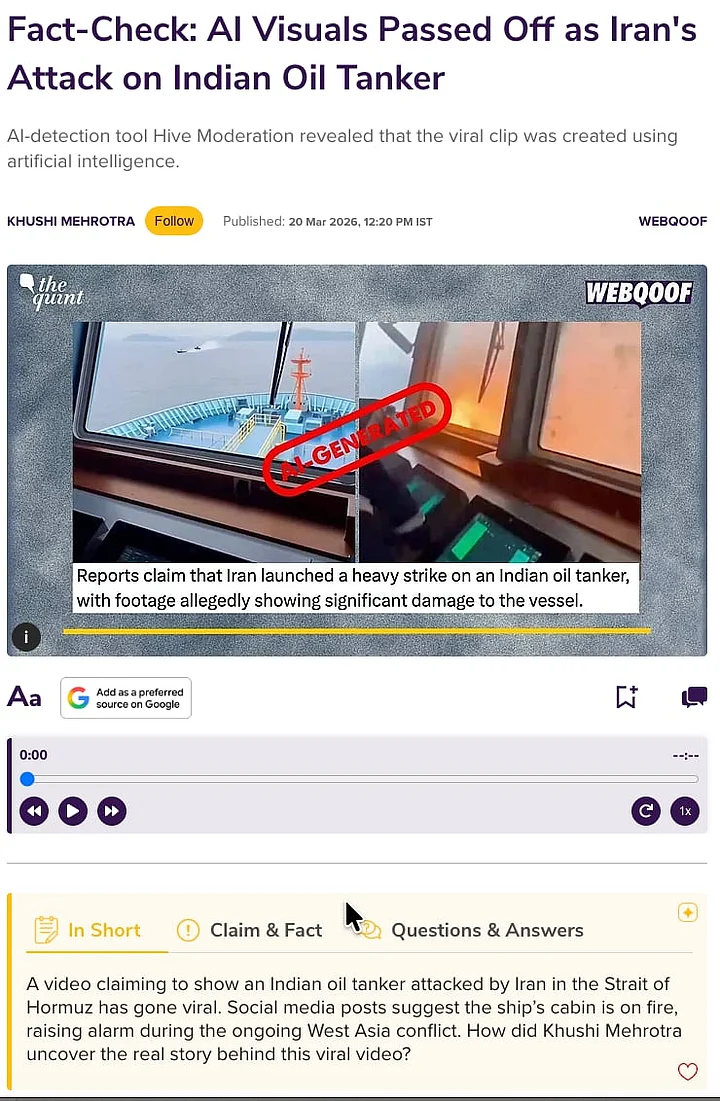

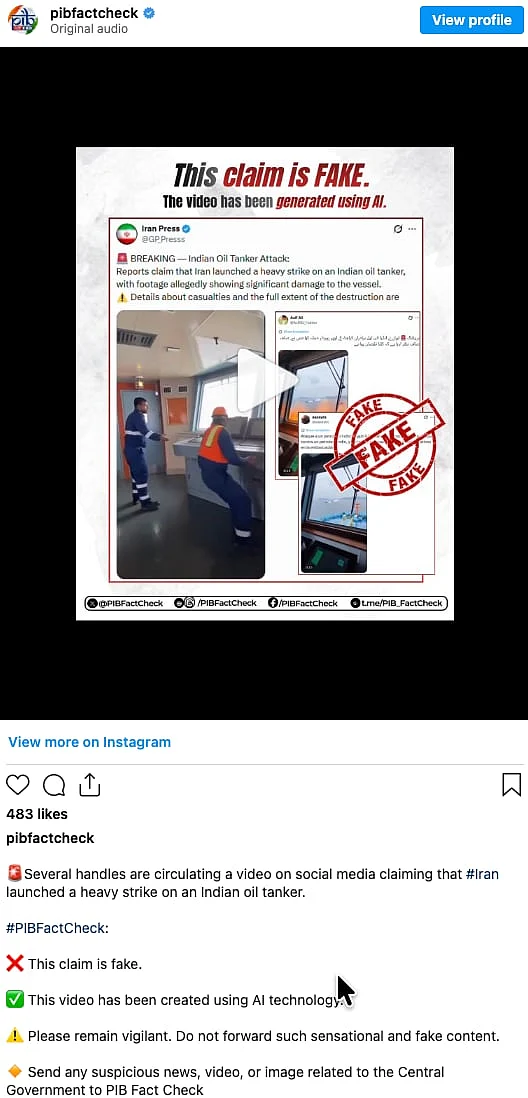

इन वीडियोज को ऐसे दावों के साथ शेयर किया गया, जैसे—ईरान ने दुबई में बुर्ज खलीफा के पास अमेरिकी ठिकानों पर हमला किया, तेल अवीव पर हाइपरसोनिक मिसाइल दागी, बहरीन में स्ट्राइक की, अमेरिकी सैनिकों को पकड़ लिया, और यहां तक कि स्टेट ऑफ होर्मुज में एक भारतीय जहाज को निशाना बनाया.

कुछ क्लिप्स में यह भी भ्रामक दावा करते हुए दिखाया गया कि कथित ईरानी हमले के बाद एक अमेरिकी सैनिक रो रहा है.

इसके अलावा, चल रहे संघर्ष को कवर कर रहे पत्रकारों के AI से बनाए गए विजुअल भी सोशल मीडिया पर शेयर किए गए हैं.

पत्रकार पालकी शर्मा का एक डीपफेक वीडियो शेयर किया गया, जिसमें झूठा दावा किया गया कि इज़रायली खुफिया एजेंसियों के लिए जासूसी करने वाले एक भारतीय मूल के व्यक्ति को बहरीन में गिरफ्तार किया गया है. इसके अलावा, एक और AI से बना वीडियो, जिसे अल जज़ीरा की रिपोर्ट बताया गया, उसमें यह गलत दावा किया गया कि नेतन्याहू की बंकर के अंदर मौत हो गई है.

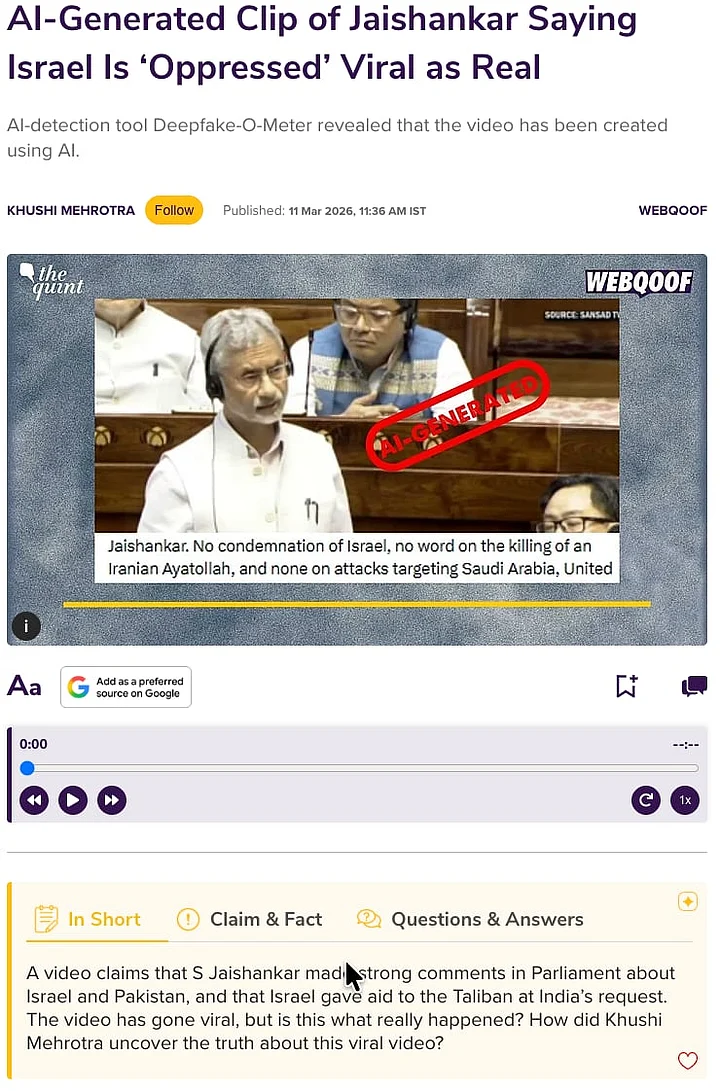

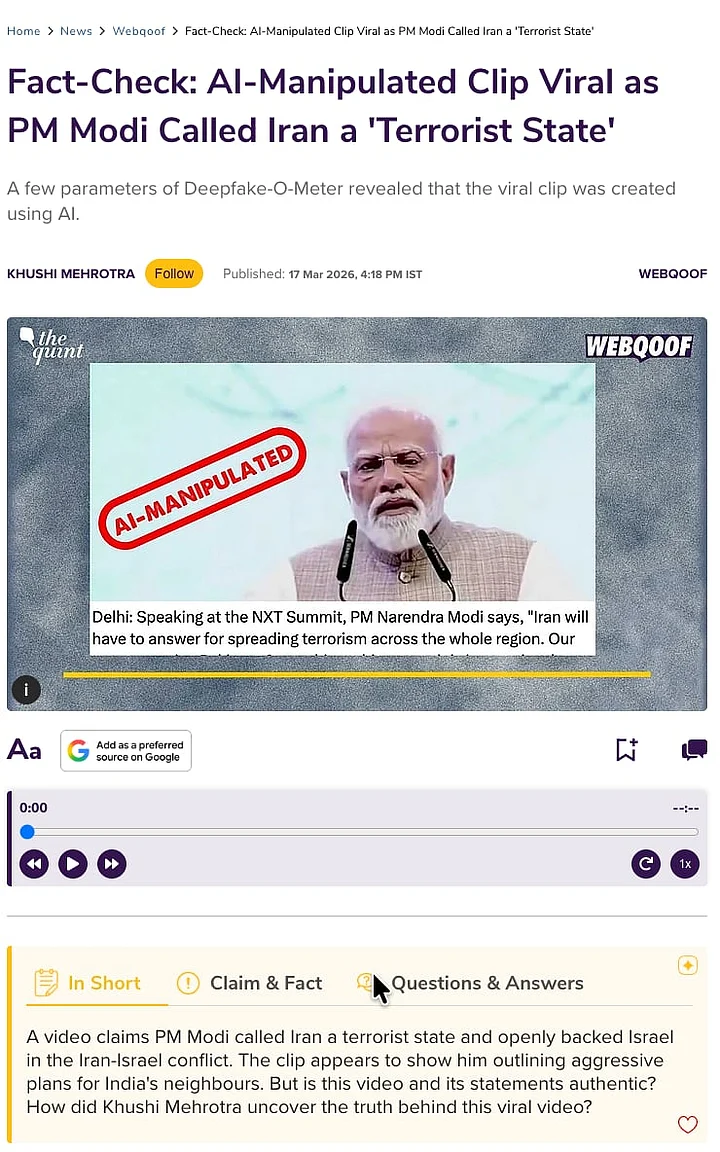

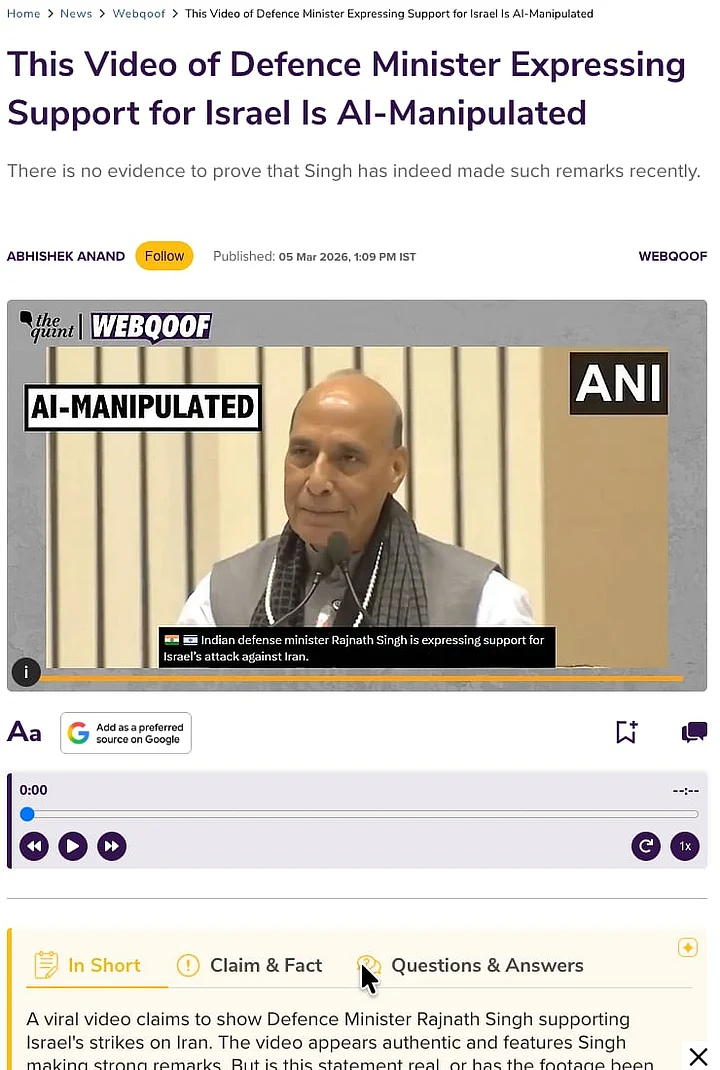

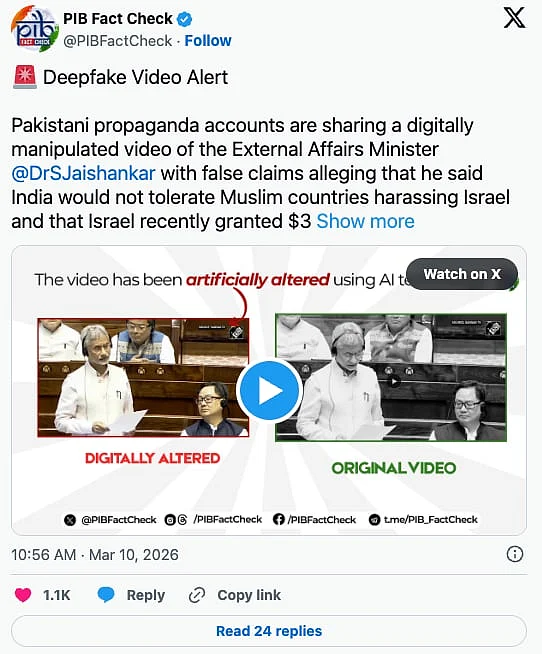

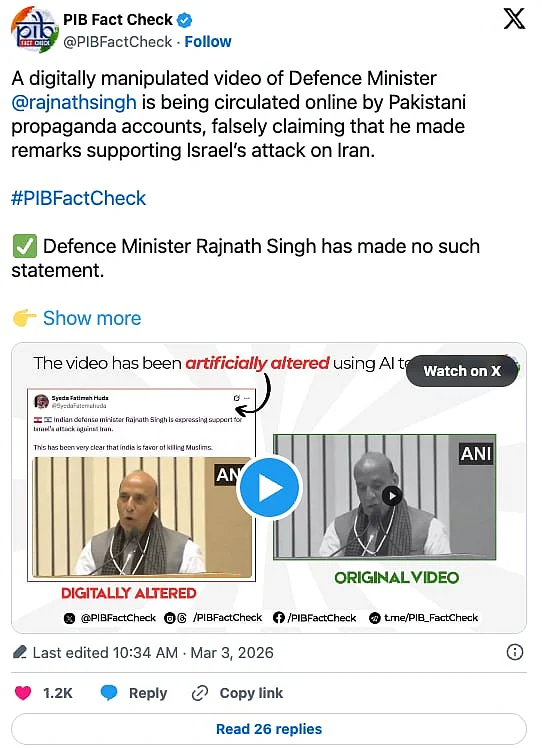

इस मामले में प्रधानमंत्री नरेंद्र मोदी, रक्षा मंत्री राजनाथ सिंह, विदेश मंत्री एस. जयशंकर और कई वरिष्ठ सैन्य अधिकारियों के AI से बने वीडियो और डीपफेक भी शेयर किए गए हैं.

AI के दौर में हो रहे युद्ध में फैक्ट-चेकिंग के मायने

AI टूल्स से बनाए गए फेक कंटेंट को गलत साबित करने के लिए पत्रकारों को भी AI डिटेक्शन टूल्स का सहारा लेना पड़ता है. लेकिन इन टूल्स की अपनी सीमाएं हैं और इन पर पूरी तरह भरोसा नहीं किया जा सकता.

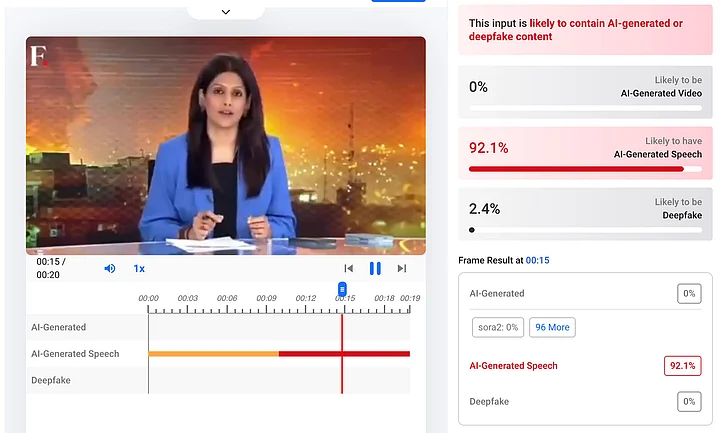

टीम WebQoof Deepfake-O-Meter, Hive Moderation, AI or Not, Sightengine, Was It AI, Contrails AI जैसे कई टूल्स का इस्तेमाल करती है.

बेंगलुरु के एक स्टार्टअप द्वारा बनाया गया टूल Contrails डीपफेक वीडियो पहचानने में बेहतर काम करता है, लेकिन AI से बने अन्य कंटेंट (AIGC) को पहचानने में कमजोर पड़ जाता है.

वहीं Deepfake-O-Meter जैसे टूल्स भी सोशल मीडिया पर वायरल मिसाइल हमलों या बमबारी के वीडियो को पहचान पाते हैं,

Google DeepMind का SynthID सिर्फ उन्हीं तस्वीरों और वीडियो को पहचान सकता है जो Google के अपने टूल्स से बनाए गए हों, जिससे बाकी कंटेंट की जांच करना और मुश्किल हो जाता है.

मॉन्ट्रियल यूनिवर्सिटी के कंप्यूटर साइंस और ऑपरेशंस रिसर्च विभाग में डॉर्साफ सलामी के डॉक्टोरल रिसर्च पेपर में बताया गया है कि AI से फेक न्यूज पहचानने वाले टूल्स लैब या नियंत्रित माहौल में काफी सटीक लगते हैं, लेकिन असल दुनिया में इनका प्रदर्शन काफी कमजोर होता है.

ये टूल्स अपने ट्रेनिंग डेटा से सीखे गए पैटर्न और संभावनाओं पर काम करते हैं, यानी इनके नतीजे पूरी तरह सच नहीं होते, बल्कि पहले से मौजूद पक्षपात (bias) भी इनमें शामिल होते हैं.

एक और बड़ी कमी यह है कि ये सिस्टम असली फैक्ट-चेकर की तरह काम करने के बजाय अपने ट्रेनिंग डेटा का के मुताबिक ज्यादा नतीजे देते हैं.

इस वजह से ये पक्षपात (bias), अधूरे डेटा और लगातार बदलती जानकारी के माहौल से प्रभावित हो जाते हैं. कई बार असली और गलत, दोनों तरह के कंटेंट की पहचान में गलती हो जाती है, खासकर जब खबरें जटिल हों या तेजी से बदल रही हों.

ये टूल्स भरोसे, संदर्भ (context) और बदलती स्थितियों के हिसाब से ढलने में कमजोर साबित होते हैं, इसलिए अकेले इनके भरोसे फेक न्यूज से लड़ना संभव नहीं है.

अल जज़ीरा मीडिया के एक रिसर्च पेपर में, जिसमें इज़रायल-गाज़ा, रूस-यूक्रेन और लेक चाड संघर्षों के दौरान AI और जानकारी के जटिल संबंध को समझाया गया है, AI और वेरिफिकेशन की सीमाओं पर भी बात की गई है.

इसमें बताया गया कि AI टूल्स का इस्तेमाल करने वाले फैक्ट-चेकरों को भाषा की दिक्कत, सांस्कृतिक फर्क और ऑटोमेटेड सिस्टम की सीमाओं के कारण बड़ी चुनौतियों का सामना करना पड़ता है. AI मॉडल अक्सर कम इस्तेमाल होने वाली और क्षेत्रीय भाषाओं को समझने में कमजोर होते हैं, जिससे गलत जानकारी आसानी से फैल जाती है.

ये टूल्स कई बार बदलते संदर्भ, जैसे नए प्रतीक (symbols) या स्लैंग को समझने में भी असफल रहते हैं और अनुवाद में गलतियां कर देते हैं, इसलिए इन पर लगातार इंसानी निगरानी जरूरी होती है.

मार्च 2025 में The Quint से बातचीत में Digital Future Lab की रिसर्च एसोसिएट अनुश्का जैन ने कहा:

AI टूल्स की बढ़ती पहुंच के कारण भ्रामक कंटेंट बनाना अब आसान हो गया है. पहले AI से विज़ुअल बनाने के लिए खास स्किल की जरूरत होती थी, लेकिन अब वह बाधा लगभग खत्म हो गई है. हालांकि, हमें यह भी समझना चाहिए कि भ्रामक सूचनाएं कोई नई समस्या नहीं हैं, बस फर्क ये है कि आधुनिक AI टूल्स ने इसे बनाने की मेहनत को काफी कम कर दिया है."अनुष्का जैन

युद्ध का भविष्य और AI

Clemson University के Media Forensic Hub की रिसर्च में बताया गया कि ईरान के पक्ष में गलत जानकारी को सोशल मीडिया पर संगठित नेटवर्क के जरिए फैलाया गया. ये अकाउंट्स खुद को यूके और आयरलैंड के आम लोगों की तरह पेश कर रहे थे.

ये नेटवर्क X, Instagram और Bluesky जैसे प्लेटफॉर्म्स पर सक्रिय थे और स्थानीय पहचान अपनाकर पश्चिमी देशों के ऑनलाइन माहौल में आसानी से घुल-मिल जाते थे, जिससे उनकी विश्वसनीयता बढ़ती थी.

खुद को असली दिखाने के लिए, इनमें से कई प्रोफाइल शुरू में स्कॉटलैंड की आज़ादी या आयरलैंड की राजनीति जैसे स्थानीय मुद्दों पर पोस्ट करते थे.

एक बार जब इन अकाउंट्स ने फॉलोअर्स बना लिए, तो उन्होंने अचानक अपना रुख बदलकर ईरान के पक्ष में और पश्चिम विरोधी (anti-West) कंटेंट शेयर करना शुरू कर दिया. इसमें अक्सर AI से बनाए गए विज़ुअल और अमेरिका व इजरायल पर हमलों के फर्जी वीडियो शामिल होते थे. इस रणनीति से प्रोपेगेंडा बिल्कुल असली और स्वाभाविक (organic) लगता था, जिससे अनजान लोग इसे सच मानकर ज्यादा भरोसा करते थे और आगे शेयर भी करते थे.

भले ही ये अकाउंट्स काफी असली लगते थे, लेकिन जांच में कुछ संकेत मिले—जैसे फारसी (Farsi) टेक्स्ट, ईरान से जुड़े मेटाडेटा और एक जैसे समय पर पोस्ट करने का पैटर्न—जिनसे इन नेटवर्क्स का खुलासा हुआ.

इन तरीकों से ईरान से जुड़े लोग छिपकर बातचीत की दिशा को प्रभावित करते थे, झूठे दावों को बढ़ावा देते थे और “स्थानीय” आवाज़ों पर लोगों के भरोसे का बड़े पैमाने पर फायदा उठाते थे.

इसके अलावा, अमेरिका के राष्ट्रपति ट्रंप ने भी आरोप लगाया कि ईरान गलत जानकारी फैलाने के लिए AI का इस्तेमाल कर रहा है, खासकर इस संघर्ष से जुड़े फर्जी फोटो और वीडियो बनाने में.

BBC की एक रिपोर्ट में “एंगेजमेंट फार्मर्स” की भूमिका का भी जिक्र किया गया, जो मुनाफे के लिए ऐसे संघर्षों से जुड़े सनसनीखेज और भ्रामक कंटेंट शेयर करते हैं.

इस पर एक्शन लेते हुए, X (पहले ट्विटर) ने 4 मार्च को घोषणा की कि अगर कोई क्रिएटर युद्ध से जुड़े AI कंटेंट के बारे में स्पष्ट जानकारी नहीं देता कि कंटेंट असली नहीं, तो उसे 90 दिनों के लिए उसके रेवेन्यू-शेयरिंग प्रोग्राम से हटा दिया जाएगा.

अल जज़ीरा की रिसर्च में यह भी बताया गया है कि सरकारी और गैर-सरकारी दोनों तरह के पक्ष अब AI से चलने वाले “सुपरबॉट्स” पर तेजी से निर्भर हो रहे हैं. इन तरीकों का असर इस संघर्ष के दौरान वायरल हुई गलत जानकारी में साफ देखा गया.

AI से चलने वाले सिस्टम बड़े पैमाने पर इंसानों जैसे दिखने वाले पोस्ट एक साथ करने में सक्षम हो गए हैं, जिससे सोशल मीडिया पर बाढ़ सी आ जाती है. वहीं बोको हरम और अंसारू जैसे समूह बड़े लैंग्वेज मॉडल (LLMs) का इस्तेमाल करके लगातार और बेहतर क्वालिटी का प्रोपेगेंडा बना रहे हैं, जिससे उनकी गतिविधियां ज्यादा पेशेवर (professional) दिखने लगी हैं.

इन तरीकों का असर इस संघर्ष के दौरान वायरल हुई गलत जानकारी में साफ देखा गया.

मोजतबा खामेनेई की मौत को लेकर झूठे दावे सोशल मीडिया पर तेजी से फैलाए गए, जबकि उनके सोशल मीडिया प्रोफाइल की तस्वीर को जांच में 99.8 प्रतिशत तक AI से बनाई गई पाया गया.

इसी तरह, बेंजामिन नेतन्याहू को लेकर भी कई अफवाहें फैलीं. जैसे एक प्रेस कॉन्फ्रेंस वीडियो में उनकी “छह उंगलियां” होने का दावा किया गया, जिसे फैक्ट-चेकरों ने गलत साबित किया और पुष्टि की कि वीडियो असली था,

प्रेस इन्फॉर्मेशन ब्यूरो (PIB) की फैक्ट-चेक यूनिट भी पश्चिम एशिया संकट के दौरान गलत जानकारी का लगातार खंडन कर रही है।

हालांकि इसका मुख्य फोकस भारतीय अधिकारियों और सैन्य जनरलों से जुड़े कंटेंट पर रहा है, लेकिन इसने AI से बने कई वायरल दावों को भी गलत साबित किया है, जैसे एक फर्जी वीडियो जिसमें ईरान द्वारा भारतीय जहाज पर हमले का दावा किया गया था.

पिछले 26 दिनों में, इस यूनिट ने ऐसे करीब 10 फैक्ट-चेक जारी किए हैं और मई 2025 से चल रहे ऑपरेशन सिंदूर जैसे पहले के अभियानों की तरह ही अपनी कोशिशें जारी रखी हैं.

ये सभी घटनाक्रम दिखाते हैं कि AI आधुनिक युद्ध को नए तरीके से बदल रहा है—सिर्फ ग्राउंड पर नहीं, बल्कि सूचनाओं की दुनिया में भी. जहां लोगों की सोच (perception) और नैरेटिव पर कंट्रोल अब बड़े हथियार बन गए हैं.

AI के इस्तेमाल से युद्ध को लंबा खींचा जा सकता है, बाजार को प्रभावित किया जा सकता है और लोगों के सामने हकीकत को भी बदला जा सकता है.

संकट/युद्ध के समय में भ्रामक सूचनाओं को कैसे पहचानें?

ऑनलाइन दिखने वाली हर चीज पर भरोसा न करें: संकट के समय सोशल मीडिया पर बहुत सारी जानकारी आती है, लेकिन सब सही नहीं होती. कुछ लोग ध्यान खींचने या फायदा कमाने के लिए AI से बने विज़ुअल और झूठे दावे फैलाते हैं.

'वेरिफाइड' अकाउंट्स से भी सावधान रहें: ब्लू टिक होने का मतलब यह नहीं कि जानकारी हमेशा सही ही होगी. कई अकाउंट्स खुद को न्यूज सोर्स बताकर भी गलत जानकारी फैला सकते हैं.

बहुत ज्यादा 'नाटकीय' विज़ुअल्स पर सवाल उठाएं: अगर कोई फोटो या वीडियो बहुत ज्यादा फिल्मी, असली से ज्यादा परफेक्ट या सनसनीखेज लगे, तो उसे तुरंत सच न मानें—पहले जांच लें.

AI डिटेक्शन टूल्स का इस्तेमाल करें: कई फ्री टूल्स हैं, जहां आप फोटो अपलोड करके देख सकते हैं कि वह AI से बना है या नहीं. जरूरत पड़े तो उनका इस्तेमाल करें.

भरोसेमंद फैक्ट-चेकर को फॉलो करें: ऐसे फैक्ट-चेकिंग संगठनों से जुड़े रहें, जो नियमित रूप से वायरल दावों की सच्चाई बताते हैं.

फैक्ट-चेक हेल्पलाइन का सहारा लें: कई फैक्ट-चेकिंग ग्रुप्स WhatsApp चैटबॉट का नंबर देते हैं, जहां आप संदिग्ध कंटेंट भेजकर उसकी जांच करवा सकते हैं.

(अगर आपके पास भी ऐसी कोई जानकारी आती है, जिसके सच होने पर आपको शक है, तो पड़ताल के लिए हमारे वॉट्सऐप नंबर 9540511818 या फिर मेल आइडी webqoof@thequint.com पर भेजें. सच हम आपको बताएंगे. हमारी बाकी फैक्ट चेक स्टोरीज आप यहां पढ़ सकते हैं.)